Conheça o MINT-1T, Um Conjunto de dados Multimodal com Um Trilhão de Tokens

Entenda o poder do MINT-1T, um conjunto de dados de código aberto, projetado para treinar modelos de inteligência artificial que podem entender e trabalhar simultaneamente com texto e imagens, lançado há pouco mais de 1 semana pela Salesforce.

Este post foi reescrito para melhor atender ao público-alvo do Brasil, mas não podemos deixar de ressaltar o maravilhoso trabalho realizado por esta equipe: Oscar Lo, Manli Shu, Hannah Lee, Etash Kumar Guha, Matt Jordan, Sheng Shen, Mohamed Awadalla, Silvio Savarese, Yejin Choi e Ludwig Schmidt.

A Salesforce acaba de anunciar o 🍃MINT-1T, um conjunto de dados de código aberto, projetado para treinar modelos de inteligência artificial que podem entender e trabalhar simultaneamente com texto e imagens.

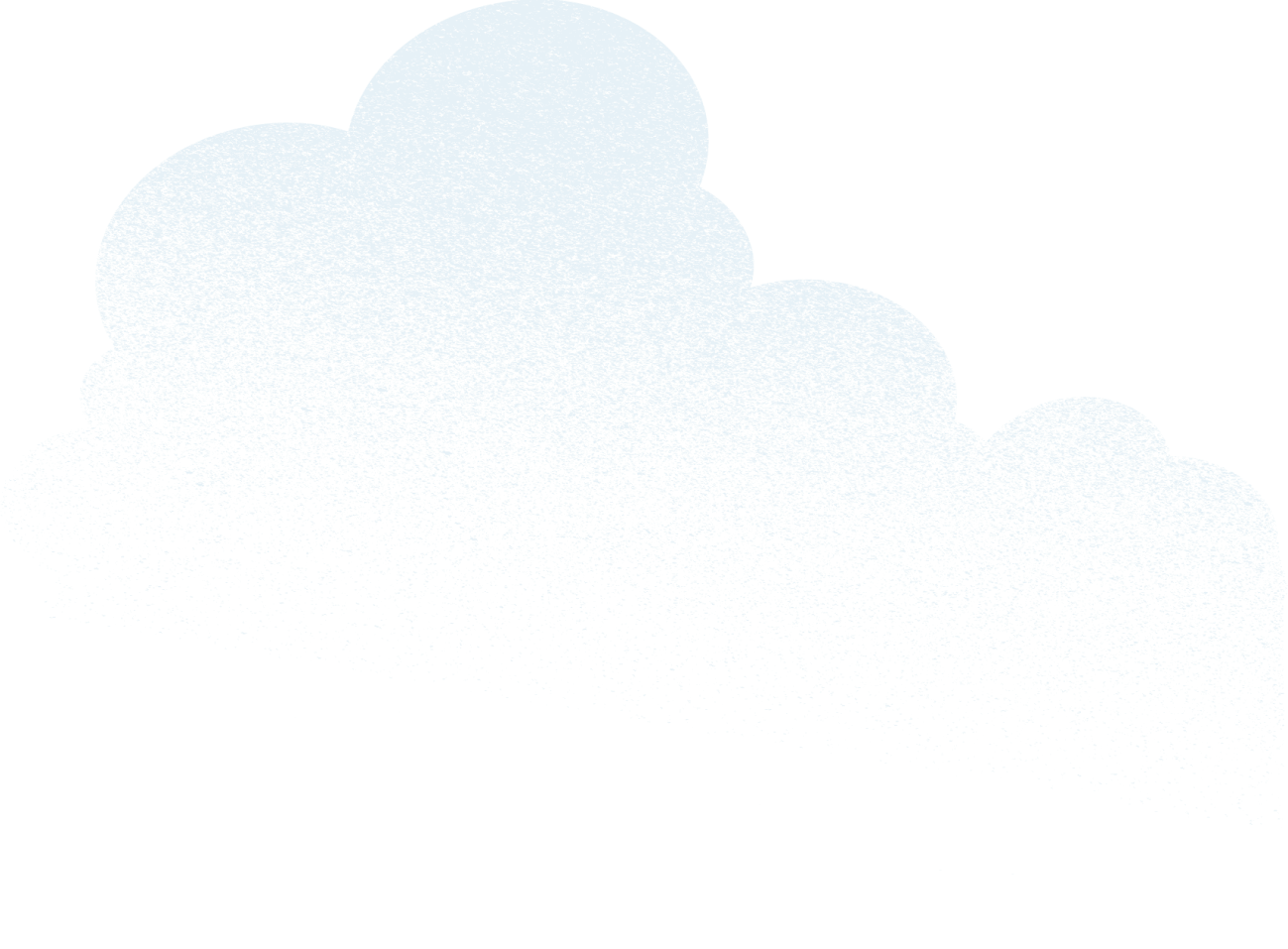

Chamado de “multimodal” por integrar diferentes tipos de dados e “intercalado” por combinar essas informações em um único fluxo contínuo, o 🍃MINT-1T é o primeiro desse tipo a atingir a marca de um trilhão de tokens de texto processáveis e 3,4 bilhões de imagens, oferecendo uma ferramenta poderosa para o desenvolvimento de modelos que lidam com múltiplas modalidades de conteúdo.

Em qual contexto nasce o MINT-1T

Documentos multimodais intercalados são essenciais para treinar grandes modelos que conseguem raciocinar sobre texto e imagens ao mesmo tempo, uma habilidade crucial para tarefas como legendagem de imagens ou resposta a perguntas visuais.

Modelos de ponta, como MM1, Chameleon, e Idefics2 , já demonstraram que o treinamento com dados intercalados é fundamental para obter um desempenho superior. No entanto, até agora, havia uma carência de conjuntos de dados multimodais de grande escala, o que limitava o desenvolvimento de modelos robustos e acessíveis.

Para saber:

- MM1, Chameleon, e Idefics2 são modelos de inteligência artificial que integram dados de texto e imagens, permitindo a realização de tarefas complexas, como interpretar imagens a partir de descrições textuais ou gerar texto com base em imagens. Eles fazem parte de uma nova geração de modelos projetados para trabalhar simultaneamente com essas duas modalidades, oferecendo maior eficiência e precisão na compreensão e geração de informações de múltiplas fontes.

Como o MINT-1T foi construído

A Salesforce desenvolveu o 🍃MINT-1T com o objetivo de escalar e diversificar os dados disponíveis. Em comparação com datasets anteriores, como OBELICS e MMC4, que tinham 115 bilhões de tokens, o MINT-1T é dez vezes maior, com um trilhão de tokens. Essa expansão permite treinar modelos mais robustos, capazes de lidar com uma ampla gama de informações. Além de documentos HTML, o MINT-1T inclui PDFs em larga escala e artigos do ArXiv, ampliando significativamente a cobertura de tópicos, especialmente em áreas científicas.

Para saber:

- ArXiv é um repositório online onde pesquisadores de diversas áreas publicam versões preliminares de seus artigos científicos. Fundado em 1991, permite que cientistas compartilhem suas descobertas rapidamente, antes da revisão por pares e publicação oficial. É amplamente usado para disseminar conhecimento e colaborar em novos trabalhos. A Salesforce implementou um rigoroso processo de engenharia para garantir a qualidade dos dados, preservando a ordem original de imagens e textos e aplicando filtragens avançadas para remover conteúdo duplicado ou irrelevante.

- OBELICS é um conjunto de dados multimodal de código aberto, composto por textos e imagens intercalados, usado para treinar modelos de inteligência artificial que trabalham com essas duas modalidades. Ele é menor em escala, mas foi um dos primeiros datasets abertos voltados para esse tipo de treinamento.

- MMC4 é outro conjunto de dados multimodal de código aberto, focado em combinar textos e imagens para treinar modelos que integram essas modalidades. Ele foi projetado para fornecer uma base diversificada para o desenvolvimento de modelos de inteligência artificial multimodal.

Experimentos com Modelos

A Salesforce validou o 🍃MINT-1T ao pré-treinar modelos multimodais XGen-MM, e os resultados em benchmarks de legendagem e resposta a perguntas visuais mostraram que o MINT-1T supera datasets anteriores, como o OBELICS. Esses benchmarks são padrões da indústria para avaliar a capacidade dos modelos em gerar descrições precisas de imagens e responder corretamente a perguntas sobre conteúdo visual. O sucesso nesses testes demonstra a eficácia do MINT-1T em melhorar a habilidade dos modelos de integrar e interpretar informações de texto e imagem simultaneamente.

O que podemos esperar do MINT-1T pela frente?

A Salesforce já está avançando para treinar novas iterações dos modelos XGen-MM com o 🍃MINT-1T e segue comprometida em oferecer à comunidade os melhores conjuntos de dados e modelos de código aberto. Novidades serão compartilhadas em breve!

Explore Mais

A Salesforce AI Research, a divisão de pesquisa em inteligência artificial da Salesforce, convida você a explorar mais sobre os conceitos discutidos neste post. A Salesforce AI Research é responsável por desenvolver tecnologias de ponta que alavancam dados e inteligência artificial para criar soluções inovadoras e acessíveis. Conecte-se nas redes sociais e no site para receber atualizações regulares sobre este e outros projetos de pesquisa.

A Salesforce agradece à equipe Le Xue, Ran Xu, Anas Awadalla, Caiming Xiong e à Srinath Reddy Meadusani e Lavanya Karanam, pelo trabalho incrível, e a Paul Josel pela ajuda com o design das figuras.

Conheça o Data Cloud

Capture e gerencie todos os dados de sua empresa em tempo real e crie valor com insights acionáveis feitos por IA, tudo isso na plataforma de CRM nº 1 mundo.