AI の進化はビジネスの効率化に大きなメリットをもたらしますが、その一方で、新たなセキュリティ課題も浮き彫りになっています。外部攻撃や、内部不正によるデータ流出、誤情報の拡散、さらには著作権侵害など、対策を怠ると自社ビジネスにおける重大なリスクを引き起こす可能性が従来よりも深刻になっています。

この記事では、以下を詳しく解説します。

- AI が抱える主要なセキュリティ課題や AI による脅威、対策

- 企業における AI 導入時に直面するリスクとその影響

- 安全に AI を活用するための具体的な対策と事例

また AI の導入を検討している方に役立つ、セキュリティリスクを最小限に抑えるポイントも紹介します。

企業がリスクを抑えてAIを導入するポイントも紹介しているため、業務にAIの導入を検討している方は、ぜひ参考にしてください。

目次

AIがセキュリティに抱える4つの問題点

AIが抱えるセキュリティリスクは、大きく分けて以下の4つがあります。

- 外部攻撃による情報漏洩

- 内部による情報漏洩

- 誤情報の拡散

- 著作権の侵害

技術の発展によってAIの汎用性が拡大しているため、人や社会を守るためにも問題点を詳しく見ていきましょう。

外部攻撃による情報漏洩

AI システムがサイバー攻撃を受けた場合、大量の個人情報や機密データが流出するリスクがあります。

医療分野では患者データ、製造業では製品設計データなどが標的になるケースが増えています。

たとえば、医療分野で活用されるAIシステムが扱う患者の住所や診療記録のような患者の個人情報など機密性の高いデータや、製造業では製品設計データなどが標的になるケースが増えています。

また、攻撃者はAIの学習データやアルゴリズムを改ざんすることで、誤った対応に繋がる結果を導き出すことも可能です。医療分野などでそうした攻撃が行われた場合、最悪の結果をもたらす可能性があります。

こうした外部攻撃からの情報漏洩に対しては、データの暗号化や厳格なアクセス制御などの対策を施し、多層的な防御策を講じることで、リスクを軽減することができます。

内部による情報漏洩

AIの発展によって業務の効率化が進む一方で、内部からの情報漏洩が懸念されます。

たとえば、従業員がAIツールを活用する際に、意図せず取引先との契約内容のような機密性の高い情報を含むプロンプトを入力することで、情報が漏洩するケースが懸念されます。

これは、機密情報をプロンプトを通じて AI がアルゴリズムのデータの一部として蓄積してしまうと、別のユーザーとの対話の中で機密情報が予期せずに露出してしまうかもしれないからです。

内部による情報漏洩を防ぐには、AIのシステムに入力しても良い情報を明確にする入力ガイドラインの徹底や、機密データの取り扱いに関する従業員教育、AIが出力する内容のモニタリングなどを実施することが重要です。

誤情報の拡散

AIによる誤情報生成が、企業の信頼を損なう大きなリスクをもたらします。AIが生成した虚偽の情報は、真実と見分けがつきにくく、拡散速度も速いため、特に注意が必要です。利用ガイドラインや事前検証プロセスを導入することで対応できます。

AIが生成した誤情報の拡散は、企業の信頼を損ない、評判を落とすなど大きなリスクをもたらします。取引先の関係が悪化したりなど、ビジネス活動に重大な混乱をもたらす危険性があります。

従来の人の手による誤情報と比べ、AIによって生成された虚偽の情報やコンテンツは、真実と見分けがつきにくく、拡散速度も速いため、特に注意が必要です。

とくにAIによって作られた偽の企業情報や、実在する社員の発言を改変した音声データが、ソーシャルメディアを通じて爆発的に拡散される可能性が問題視されています。

AIによる誤情報の拡散を防ぐには、社内での利用ガイドラインの設定や情報の出所を確認できる仕組みの構築など、技術面や組織面での包括的な対策が必要になります。

著作権の侵害

さらに、AI が生成したコンテンツが著作権を侵害するリスクも無視できません。既存のデータや作品を学習に使う AI では、無許可で第三者の権利を侵害してしまう可能性があります。

企業がAIシステムを導入・運用する過程で、著作権で保護された作品を無許可で使用する可能性が指摘されている一方で、創作者の権利を守る体制が不十分な状況です。

たとえば、社内での AI 活用において、アーティストの作風を模倣したコンテンツの制作や、既存の著作物に酷似した販促物の作成により、著作権者の権利が侵害されるリスクが挙げられます。

企業における AI の著作権侵害を防ぐには、社内での生成 AI の利用ガイドラインの整備や、ビジネス活用に向けた著作権者との適切なライセンス契約の締結を行い学習データセットに含まれる著作物の使用許諾を得ておくなど、包括的な対策が必要です。

AIによるセキュリティに問題を与える4つの脅威

AI の進化に伴い、従来のセキュリティ課題が新たな形で表面化しています。ここからは、AI を活用した攻撃やリスクについて紐解いていきましょう。

AI によるセキュリティに問題を与える脅威は、以下の4つです。

- フィッシングメール

- DDoS攻撃

- AIファジング

- 機械学習ポイズニング

AI によるセキュリティリスクを最小限に抑えるには、企業全体での包括的な対策が必要です。AIによる脅威の傾向を把握できるように、それぞれを詳しく見ていきます。

フィッシングメールの高度化

AI を活用したフィッシングメールは、AI が大量のデータを分析することによって、文章としての正確さに加えて、より自然な言い回しまで模倣した、一見信憑性の高いメッセージを生成します。さらに、送信後のデータを AI に分析させて精度を高め、よりターゲットに合った攻撃を仕掛けるさことも可能です。

たとえば、以下のような危険性があります。

- 開封率の高いメールやクリックされたリンクの傾向を分析し、分析結果にもとづいた調整を行う

- 標的の嗜好に合わせた内容のカスタマイズ

- 本物と見分けのつかない精巧なメール

ITの教養があるユーザーでさえも、本物のメールと見分けることが困難になっており、情報セキュリティにおける新たな課題として危険性が指摘されています。

対応策としては、送信元アドレスの厳密な確認や、不審な添付ファイルを開かないといった、より慎重な対応とともに、AI を活用したスパムフィルタなどの導入などを組み合わせていくことなどが挙げられます。

DDoS 攻撃の進化

DDoS 攻撃は、複数の端末から大量のアクセスを集中させることによって、システムを機能不全に陥らせる悪質なサイバー攻撃です。AI の発展により、その攻撃手法が著しく高度化しています。

AIは対象システムの脆弱性を自動的に分析し、従来の防御システムでの検知が困難な、正常なアクセスを模倣したトラフィックを作り出すなど効果的な攻撃パターンを生成し、従来のシステムによる防御を突破します。

こうした、精巧かつかつてない規模の攻撃が可能となったことで、重要なインフラやクラウドサービスまでもが標的となる可能性があります。

企業は以下のような定期的な脆弱性診断と防御体勢の見直しを行い、最新の脅威に備える必要があります。

- 定期的な脆弱性診断の実施

- 攻撃検知システムの AI 対応の強化

- 多層的な防御策の導入

AI ファジングの脅威

AIファジングは、従来の方法では検出できない未知の脆弱性を AI を活用することで短時間で特定する手法です。

悪意のある攻撃者が AI ファジングを悪用すると、従来の手法では発見できなかった未知の脆弱性を短時間で特定し、大規模なサイバー攻撃を仕掛ける恐れがあります。

AI によって自動化された攻撃は、従来の防御策では対応が困難であり、システムのセキュリティを著しく脅かします。

悪意のあるAIファジングに対抗するには、以下のような対処が有効です。

- 異常検知 AI によるファジング活動の監視

- 自動パッチ生成による迅速な脆弱性修正

- 継続的な AI セキュリティ更新

機械学習ポイズニングのリスク

機械学習ポイズニングでは、AI モデルに誤ったデータを意図的に混入させ、判断基準を操作します。結果として、不正な認証や誤った診断が引き起こされる可能性があります。

たとえば、顔認証システムに細工したデータを学習させて特定の人物を誤って認識させたり、セキュリティシステムに対して攻撃を検知できないように学習を妨害したりといったことが可能です。

機械学習ポイズニングを防ぐには、データの出所や学習過程を監視する体制を構築したり、異常なデータの混入を早期に発見する検証を行ったりする包括的な対策が求められます。

AIを活用した4つのセキュリティ対策

複雑化する脅威に対応するため、AI そのものをセキュリティ対策に活用することが効果的です。AI を活用したセキュリティ対策について見ていきましょう。

- マルウェアの検出

- 不正アクセス・不正利用の検知

- ユーザー認証

- セキュリティ診断

マルウェア検出の強化

AI を活用したマルウェア検出では、ディープラーニングを用いることで未知のマルウェアや変異型を特定しています。AI の継続的な学習により、巧妙に変異を繰り返す亜種など、新しい脅威にも柔軟に対応可能です。

AI は膨大な量のプログラムコードや通信パターンを分析し、不審な振る舞いを瞬時に検知できます。さらに、検知したマルウェアの特徴を自動的に学習することで、検出精度を継続的に向上することが可能です。

サイバー攻撃が日々進化する中、AI による予測的な防御は組織のセキュリティ体制を強化する重要な要素となっています。

不正アクセス・不正利用の検知

システムやネットワークの通常の利用パターンをAIに学習させることによって、通常とは異なる不自然な振る舞いを即座に識別し、不正アクセスや不正利用を防止できます。

たとえば、通常とは異なる不自然な振る舞いとは、以下のとおりです。

- 普段と異なる時間帯のログイン

- 急激なデータ転送量の増加

- 通常とは異なる IP アドレスからのアクセス

また、AI は過去の攻撃パターンを学習することによって、新たな脅威に対する予測的な防御を実現できます。

従来のルールベースの検知では見逃されていた巧妙な不正アクセスも、AIによる行動分析と異常検知により、早期発見と対策が可能です。

ユーザー認証の高度化

AI を活用することで、IP アドレスやアクセス元の位置情報をリアルタイムで分析することなどで、不審なログインを早期に検知できます。

たとえば、AI が学習したユーザーの接続パターンと照合して、普段と異なる地域や未登録のデバイスからのアクセスを検知した場合、即座にユーザーへの警告通知を送信するとともに、セキュリティレベルを自動的に引き上げることが可能です。

また、ワンタイムパスワードの発行や登録済みのスマートフォンへのプッシュ通知など、多要素認証による追加の本人確認を要求することで、不正アクセスを未然に防ぎます。

セキュリティ診断の自動化

AI を活用したセキュリティ診断では、高度な機械学習アルゴリズムにより、システムの脆弱性を包括的に分析し、潜在的なセキュリティリスクを効率的に特定できます。

従来のセキュリティ診断では見落としがちだった複雑な脆弱性パターンも、AI が 24 時間 365 日リアルタイムで監視することで、早期発見が可能です。

また、AI による疑似的な攻撃シミュレーション機能を利用すると、実際のサイバー攻撃に近い手法でシステムの耐性をテストし、潜在的なリスクを可視化できます。

検出された問題に対して、AI が優先度を付けて改善提案を行うため、効果的な対策を迅速に実施できます。

企業が取るべき 3 つのセキュリティ対策

安全に、安定した AI を活用することで業務効率化を実現するために押さえておきたいポイントは、以下の3つです。

- ガイドラインの策定

- 従業員教育の実施

- セキュリティ対策されたシステムの導入

ガイドラインの策定

企業において従業員が AI を適切に利用できるよう、AI 導入時のセキュリティ対策として、データの取り扱い基準やアクセス権限管理などを明確にしたガイドラインの整理と策定が重要な役割を果たします。

ガイドラインに記載するべき項目の例は、以下のとおりです。

- データの取り扱い基準

- 機密情報や個人情報の入力制限

- 許可された使用範囲の明示

- アクセス権限の管理方法

先進企業の成功事例や失敗事例を取り上げて、社員が理解しやすい形でルールを提示することによって導入効果を高められます。

また、定期的に見直しと更新を行うことによって、変化の早い AI 技術に対応できる柔軟なガイドラインを実現していくことが重要です。

従業員教育の実施

AI の導入時にガイドラインを整備して、セキュリティ対策を実施したとしても、従業員が AI の特性を理解していなければ、適切に運用されない可能性があります。

そのため、以下のような AI への正しい認識を深める工夫を組織全体で行なっていくことが必要です。

- 社内勉強会による AI リテラシーの向上

- 部門ごとの活用事例の共有

- 外部専門家を招いたセミナーの開催

AI の出力内容の精度や著作権、プライバシーに関する課題について、実例を交えながら啓発活動を行うことで、安全かつ効果的な活用が実現できます。

セキュリティ対策されたシステムの導入

AIシステムを企業に導入する際は、業務効率化や生産性向上といった効果だけでなく、セキュリティ対策の観点から慎重に検討する必要があります。

各ベンダーが提供するAIシステムのセキュリティ機能を比較し、データの暗号化レベルやアクセス権限の管理機能など、自社のセキュリティ要件を満たしているかを確認しましょう。

企業の機密情報や顧客データを扱う場合には、入力内容をAIの学習データとして使用しないオプトアウト機能が備わったシステムを導入すると、情報漏洩のリスクを最小限に抑えられます。

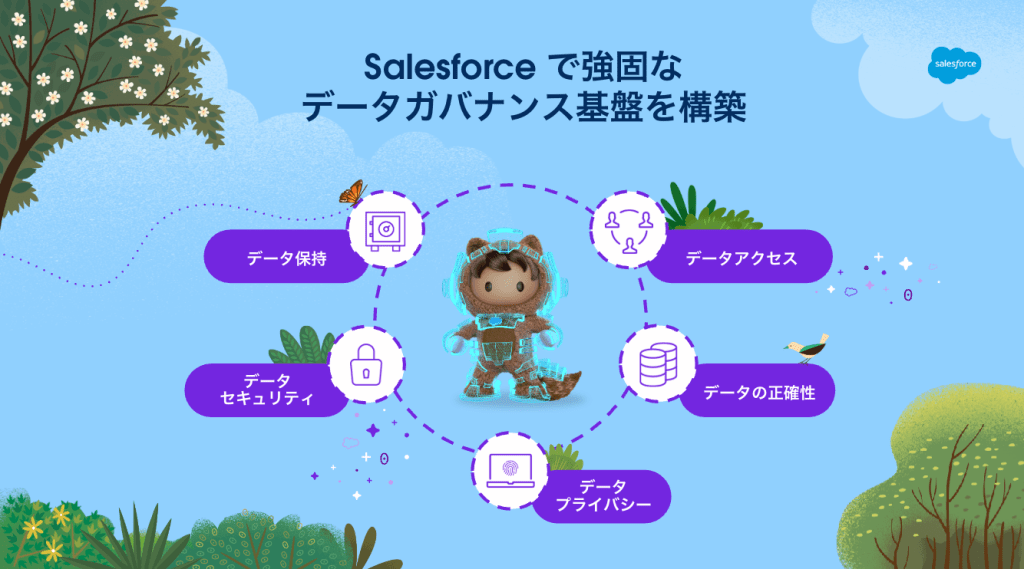

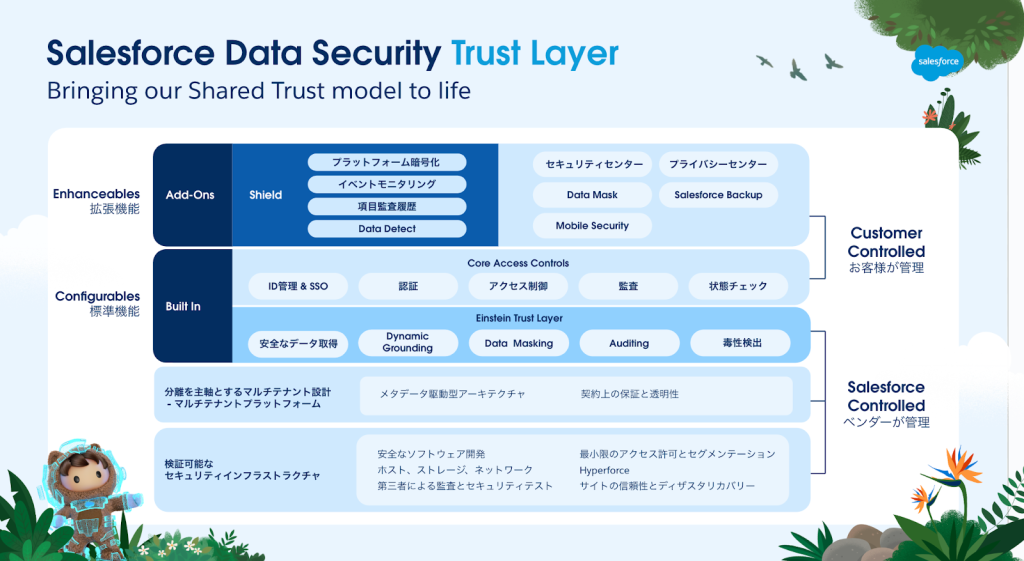

Salesforce + セキュリティアドオン製品を組み合わせることでセキュリティリスクを抑えつつ AI やデータ活用ができる

Salesforce のセキュリティ製品群は、企業のデータを保護しながら業務効率化の向上と、コンプライアンス要件への対応の両立を支援します。

たとえば、セキュリティ製品である Salesforce Shield を活用した具体例は、以下のとおりです。

- 監査機能の強化:Salesforce のプラットフォーム全体でのユーザーアクティビティをモニタリングし、不正アクセスや不適切な操作を即座に検知

- 暗号化によるデータ保護:データの保存や利用時に暗号化を適用し、内部や外部の脅威から情報を保護

- 確実な証跡管理:項目へのアクセス履歴やシステムイベントの追跡を詳細に記録し、透明性を確保

こうした機能により、企業データの安全性を向上させながら、規制に準拠した運用を実現します。また、Shield のプラットフォーム暗号化などを活用することで、データ漏洩のリスクを低減し、顧客やビジネスパートナーからの信頼を高めることができます。

Salesforceのセキュリティ製品の一覧については、以下の eBook でそれぞれのポイントをクイックにご覧いただけます。ご興味のある方は、ぜひチェックしてみてください。

AI導入検討者必見!

生成AIのリスクを軽減する10の戦略

多くの企業が生成AIの導入を急いでいますが、同時にセキュリティリスクへの対処も必須となっています。 生成AIをビジネスに導入する際に、担当者が考えるべきポイントを10個に集約し、具体的な対策を紹介します。

まとめ:セキュリティリスクへの対策を講じてAIを導入しよう

AIには外部や内部による情報漏洩、誤情報の拡散や著作権の侵害といったセキュリティ上の問題点があります。

そのため、企業でAIを安全に活用するには、明確なガイドラインの策定や従業員への正しい認識の周知、セキュリティ対策されたシステムの導入が重要です。

AIシステムを導入する際は、業務効率化や生産性向上といった効果だけでなく、セキュリティ対策の観点から慎重に検討しましょう。

Salesforce の AI は、大規模言語モデルに機密情報を反映させない設計により、情報漏洩リスクを最小限に抑えて、繰り返し行う単純作業や日々の定型業務などの営業プロセスを自動化できます。また、それに加えてセキュリティアドオン製品を導入・設定することで、より高い安全性を実現しつつ高度な生産性向上に AI を役立てていくことができるようになります。

セキュリティリスクを抑えたAIシステムの導入にご興味のある方は、以下の資料も合わせてご覧ください。